Contents

Motivações

As pesquisas hoje sendo transferidas ao mercado sobre Sistemas Automatizados de Apoio ao Motorista (ADAS) quanto em Veículos Autônomos para uso civil tem sido principalmente dirigida às condições da estrada comumente encontrada em países desenvolvidos, supondo boas condições de pavimento e manutenção adequada da estrada. A pesquisa tem ignorado os problemas colocados por estradas de terra, buracos grandes, saídas de terra e interrupções inesperadas no pavimento, condições comumente encontradas em países em desenvolvimento, mesmo em certas partes de áreas urbanas, como periferias da cidade. Um veículo autônomo, para ser usado com sucesso em um contexto de país em desenvolvimento, deve ser capaz de lidar com essas diferentes condições.

Segundo a Confederação Nacional do Transporte (CNT) no Brasil, de 103.259 km de rodovias analisadas em 2016 (abrangendo toda a malha rodoviária federal e as principais rodovias estaduais pavimentadas), 48,3% receberam classificação regular, ruim ou péssimo em relação ao pavimento. Com um aumento de pontos críticos (que incluem grandes buracos) de 26,6% em comparação com o ano de 2015 (CNT, 2016).

LIDAR = Lasersmog?

Por outro lado, o reconhecimento de caminho e obstáculos tem sido fortemente dependente da informação obtida da LIDAR e de outros métodos ativos de reconhecimento de terreno. Entendemos que, enquanto os veículos autônomos sejam um fenômeno raro, a poluição causada pela LIDAR não é uma preocupação e não pode ser considerada um risco para a saúde. Se, no entanto, imagina-se uma típica situação de engarrafamento no horário das 17:00 em qualquer cidade grande, onde todos esses carros são veículos autônomos, então, durante uma curta caminhada do escritório para a estação de metrô ou enquanto espera no ponto de ônibus, um pedestre típico estaria exposto às emissões laser de milhares de carros e isso todos os dias. As retinas desses pedestres poderiam potencialmente receber uma grande quantidade de emissão de laser, mesmo que cada laser seja uma fonte de baixa intensidade. Este cenário pode representar um perigo para a saúde.

Em (GROUP SAFETY PUBLICATION. Safety of laser products.) é apresentado uma tabela com a categorização dos lasers e os possíveis riscos com o excesso de exposição a cada um dos níveis. Os lasers com comprimento de onda entre 780nm e 1400nm, que é a faixa de abrangência do LIDAR, podem causar catarata e queimar a retina. Os carros autônomos são uma nova tecnologia e quase não há estudos sobre riscos para a saúde causados por eles. Ainda não podemos dizer se a exposição prolongada a este cenário (que chamamos de “lasersmog“) apresenta um risco grave ou não, mas entendemos que é uma estratégia promissora para desenvolver um conceito de carro autônomo que não depende da visão ativa para reconhecimento de obstáculos e estradas.

Nossa Solução: Visão Passiva aliada a Moderna Inteligência Artificial

Nós entendemos que o futuro da percepção na faixa da radiação luminosa para ADAS e Veículos Autônomos está na percepção visual passiva, através de câmeras e Visão Computacional, não em emissores de radiação como LIDAR e RADAR (também usados em alguns veículos já comercializados). Desde 2012 temos dedicado pesquisas a desenvolver soluções baseadas nessa premissa. Veja aqui a nossa playlist no YouTube mostrando soluções desenvolvidas desde 2012.

Percepção de Sinais e Propriocepção

O nosso trabalho vai além de somente Visão Computacional para previsão doi caminho e obstáculos: da mesma forma que nós humanos quando caminhamos em um terreno usamos outros sentidos para saber a qualidade do caminho e para saber se estamos escorregando ou se o piso é firme, um sistema de ADAS ou de Navegação Autônoma em um veículo também deve ser capaz de fazer isso, detectando o piso e a atitude do carro em tempo real. Para isso usamos Captura e Análise Inteligente de Sinais com sensores inerciais: tanto o sensoriamento do piso, para identificação do tipo de piso (e cruzamentro dessas informações com informações visuais, por exemplo para saber se uma lombada foi detectada corretamente) quanto a propriocepção da identificação da Atitude do carro em situações que o controle de tração não conbsegue identificar (estou derrapando? a curva é muito fechada?) são informações importantes que devem ser adquiridas e processadas.

Objetivos

Com base nessas duas diretrizes de estratégia geral colocadas acima, o objetivo do nosso projeto é desenvolver e testar um conceito para um veículo autônomo que:

- é capaz de navegar em estradas urbanas e não-urbanas normalmente encontradas em países em desenvolvimento, sendo capazes de lidar com estradas de terra, barrancos de terra, buracos grandes, interrupções no pavimento, valas e

- pode executar essas tarefas de navegação sem ter que depender de métodos de visão ativa, usando para sua percepção visual somente abordagens de visão passiva, câmeras.

Outros Usos: Concessionárias e Expeditoras

Essa tecnologia tem outras aplicações além de ADAS e Navegação Veicular Autônoma: monitoramento automatizado de condições nas estradas, por exemplo. Uma área de aplicação útil tanto para Concessionárias de Rodovias, que podem embarcar nossa solução em veículos que passam a monitorar automaticamente o estado da rodovia usando um ensemble de visão e sensores, quanto para Expeditores que querem avaliar o custo-benefício de diferentes rotas em função da qualidade das estradas e não apenas das distâncias de cada rota.

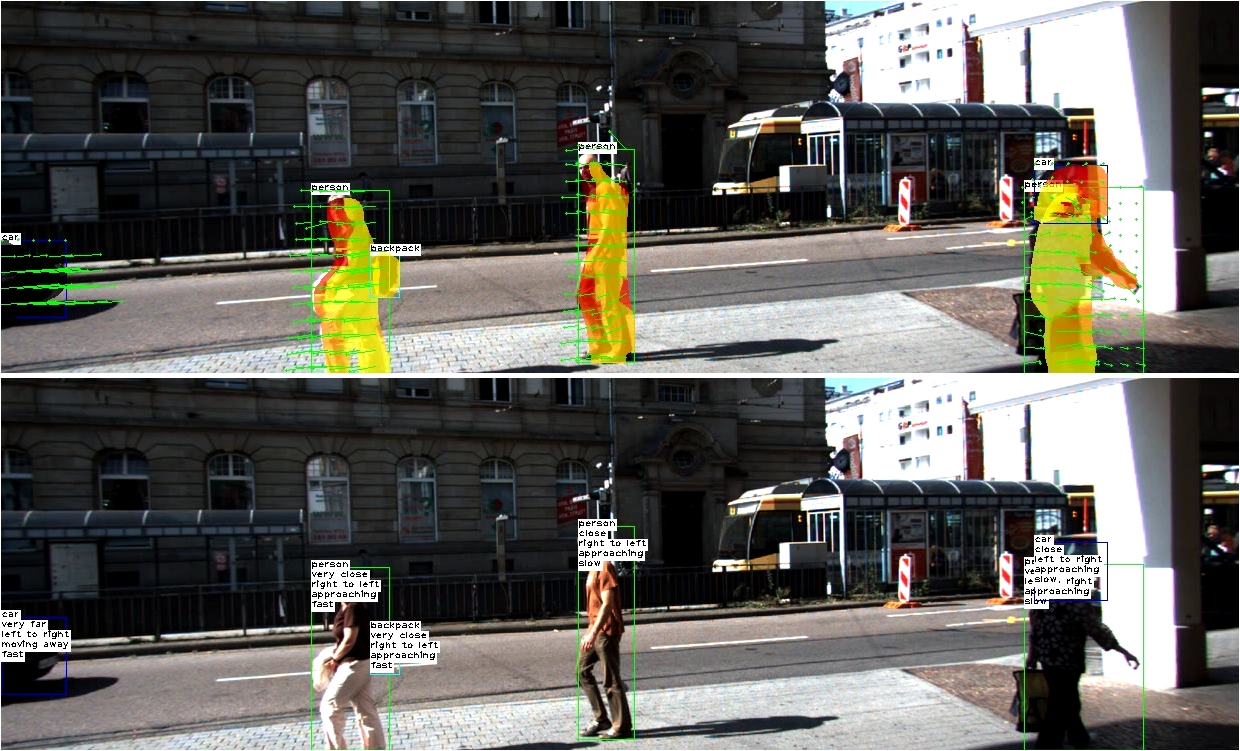

Resultado da detecção e extração de movimento e distância de obstáculos na base KITTI. Saiba mais aqui.